Il conflitto che si è riacceso tra Stati Uniti, Israele e Iran è uno scontro geopolitico e, insieme, una finestra sul futuro della guerra. Missili guidati da algoritmi, sistemi di analisi che selezionano obiettivi, droni che prendono decisioni sempre più autonome: l’intelligenza artificiale è già dentro il campo di battaglia.

Mentre a Teheran cadono i missili, a migliaia di chilometri di distanza diplomatici, giuristi e ricercatori si riuniscono a Ginevra per discutere un problema sempre più urgente: come regolare l’uso dell’IA nei conflitti armati. Il ritmo della tecnologia, però, corre molto più veloce della politica.

Secondo il politologo Michael Horowitz dell’Università della Pennsylvania, i sistemi di intelligenza artificiale vengono già utilizzati dall’esercito statunitense per analizzare intelligence, coordinare la logistica e supportare le decisioni militari. Tra gli strumenti più citati c’è il sistema Maven, una piattaforma che sfrutta l’analisi automatica di immagini e dati per suggerire obiettivi militari.

L’illusione della guerra “più precisa“

Una delle promesse più ricorrenti dell’intelligenza artificiale militare è la precisione. Algoritmi più veloci e capaci di analizzare enormi quantità di dati dovrebbero ridurre gli errori e, in teoria, anche le vittime civili.

I conflitti recenti – dall’Ucraina a Gaza – hanno già visto l’uso dell’IA per identificare bersagli o guidare droni. Nonostante questo, le vittime civili restano altissime. Come si legge su Nature, per Craig Jones, geografo politico dell’Università di Newcastle, non esistono prove che questi sistemi riducano davvero questo tipo di “errore”. In alcuni casi, sostiene, potrebbero persino amplificarlo.

Il problema è strutturale: gli algoritmi ragionano su dati incompleti e contesti complessi, proprio come gli esseri umani. Ma senza esperienza morale o responsabilità diretta.

La linea rossa delle armi autonome

Il punto più controverso riguarda le cosiddette armi completamente autonome: sistemi in grado di individuare, selezionare e colpire un bersaglio senza intervento umano.

Per molti ricercatori, questa prospettiva non è solo tecnologicamente rischiosa ma anche eticamente inaccettabile. Il diritto umanitario internazionale impone infatti di distinguere tra combattenti e civili, una valutazione che richiede contesto, interpretazione e giudizio.

Secondo la politologa Toni Erskine dell’Australian National University, sostituire completamente l’essere umano nella catena decisionale militare potrebbe addirittura aggravare i conflitti invece di contenerli.Il suo gruppo di ricerca ha pubblicato nel 2025 una serie di raccomandazioni politiche per limitare l’uso dell’IA nei sistemi d’arma.

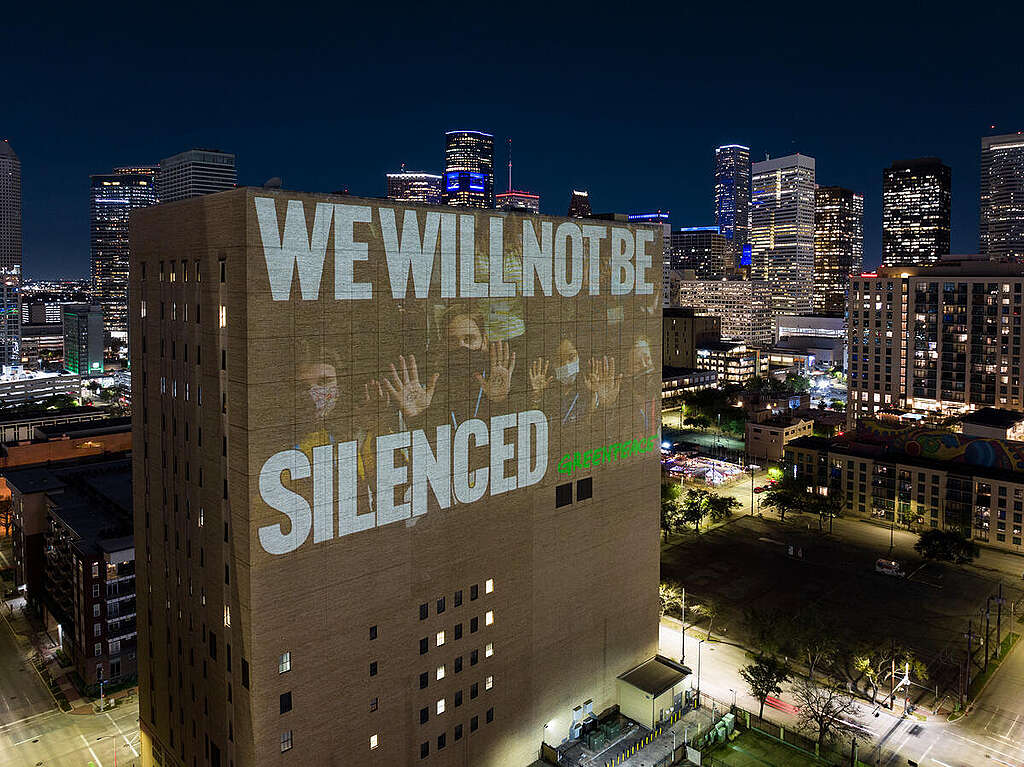

Nel frattempo, dipendenti di diverse aziende tecnologiche stanno firmando petizioni interne per impedire che i loro modelli vengano usati per sistemi di sorveglianza o per armi autonome letali.

Un diritto internazionale ancora incompleto

Sul piano diplomatico il tema è sul tavolo da anni. La Convenzione ONU su alcune armi convenzionali (CCW) discute da tempo la possibilità di limitare o vietare i sistemi d’arma autonomi.

Il problema è politico prima ancora che giuridico. Gli Stati più avanzati nello sviluppo militare dell’IA – Stati Uniti, Israele e Cina – sono anche quelli meno favorevoli a nuove restrizioni.In altre parole, chi guida la corsa tecnologica difficilmente accetterà di rallentarla.

Il risultato è una situazione paradossale: la guerra algoritmica avanza rapidamente, mentre le regole globali che dovrebbero governarla restano ancora in fase di bozza.